Los avances recientes en robótica humanoide han creado la percepción de un cambio de paradigma, con empresas que promueven un futuro poblado por sofisticados androides capaces de maniobras complejas. Si bien las demostraciones muestran robots realizando tareas intrincadas como breakdance o manipulando objetos irregulares, una mirada más de cerca revela que incluso los modelos líderes todavía tienen dificultades con desafíos básicos del mundo real, como navegar escaleras de forma fiable o abrir puertas. Los expertos en el campo reconocen que estas tareas aparentemente sencillas siguen en gran medida sin resolverse para sus robots insignia.

Esta aparente paradoja se deriva de una serie de avances tecnológicos significativos en la última década. Primero, el aprendizaje profundo, aprovechando redes neuronales y chips GPU rápidos, mejoró drásticamente la visión por computadora y el aprendizaje por refuerzo. Esto permitió a los robots percibir e interactuar con sus entornos con una velocidad y sofisticación sin precedentes. Segundo, alrededor de 2016, una revolución en la actuación reemplazó los pesados sistemas hidráulicos por motores eléctricos más pequeños y «propioceptivos». Estos motores confirieron una agilidad similar a la de los animales y una adaptabilidad crucial, lo que permitió a los robots absorber impactos y adaptarse a perturbaciones del mundo real sin sufrir daños. Este hardware adaptable fue un facilitador clave para la aplicación práctica del aprendizaje por refuerzo. Finalmente, la adaptación de los grandes modelos de lenguaje para robótica, lo que llevó a los modelos de visión-lenguaje-acción (VLA), ha empoderado a los robots para planificar y ejecutar tareas de varios pasos de forma autónoma basándose en comandos de lenguaje natural y entrada visual, unificando enfoques previamente dispares para la percepción, planificación y control robóticos.

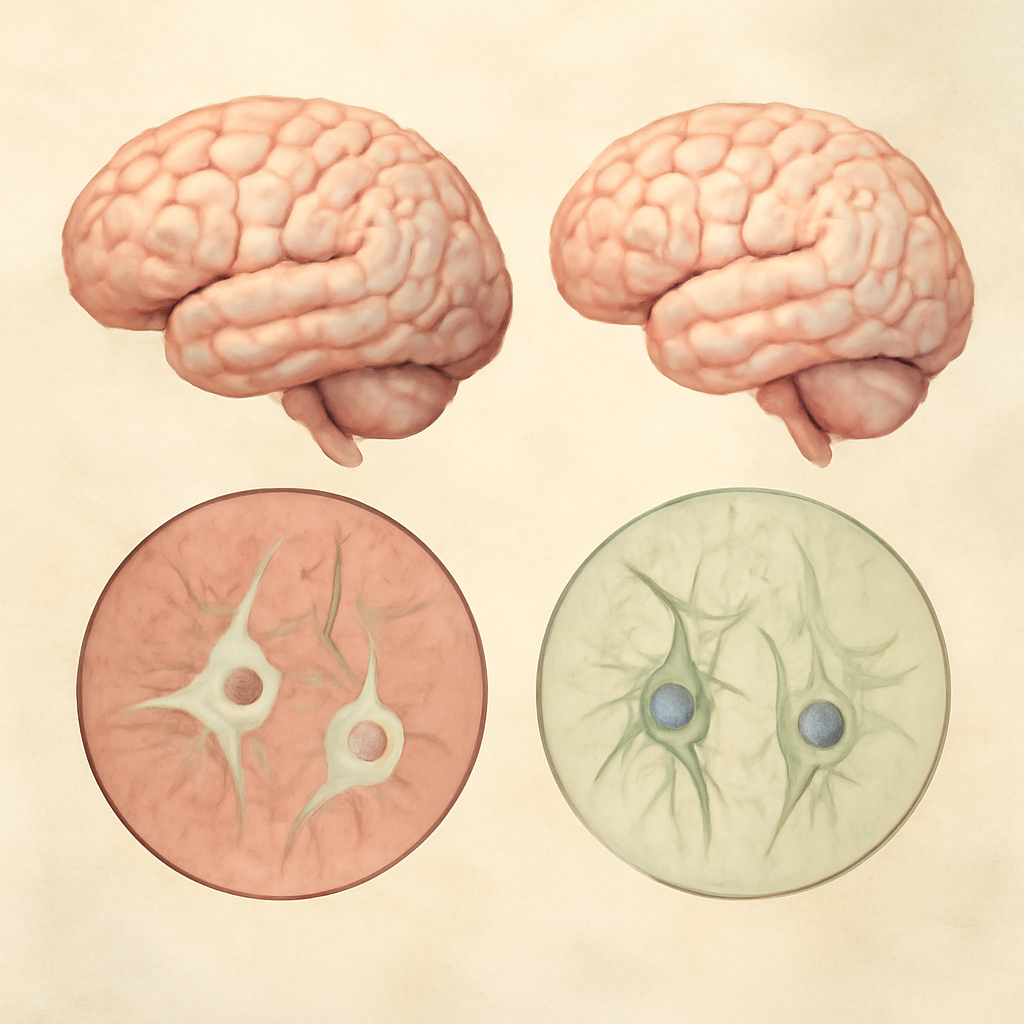

Estos tres avances transformaron colectivamente la robótica humanoide. El aprendizaje por refuerzo profundo ahora permite a los robots aprender políticas de «control de cuerpo completo» a través de innumerables simulaciones digitales, coordinando el movimiento, el equilibrio y la evitación de colisiones sin necesidad de algoritmos diseñados manualmente o modelos físicos simplificados. Los actuadores adaptables, pioneros gracias a investigadores como Sangbae Kim, hicieron posible que los robots aprendieran y se recuperaran de errores en el mundo real, lo que antes era prohibitivo debido a los frecuentes daños al hardware. Los modelos VLA, ejemplificados por el trabajo de Google DeepMind, permiten a los robots interpretar comandos como «Tengo sed» y generar de forma autónoma los pasos físicos necesarios, desde encontrar una taza hasta recogerla.

A pesar de estos profundos desarrollos, que han llevado a una sólida encarnación física y un nivel fundamental de inteligencia generalizable, los humanoides aún no se consideran «resueltos» ni siquiera en principio. La dificultad persistente con la ejecución fiable de interacciones comunes y a pequeña escala en entornos no estructurados sugiere que aún persiste un desafío más profundo para salvar la brecha entre las demostraciones impresionantes y la utilidad práctica y consistente en entornos cotidianos.

¿Por qué los robots humanoides siguen teniendo dificultades con las cosas sencillas?